[IBM AI course #2] Introduction to Deep Learning & Neural Networks with Keras

딥러닝 알고리즘은 생물학적 뉴런의 작동 방식을 모방하고 있다.

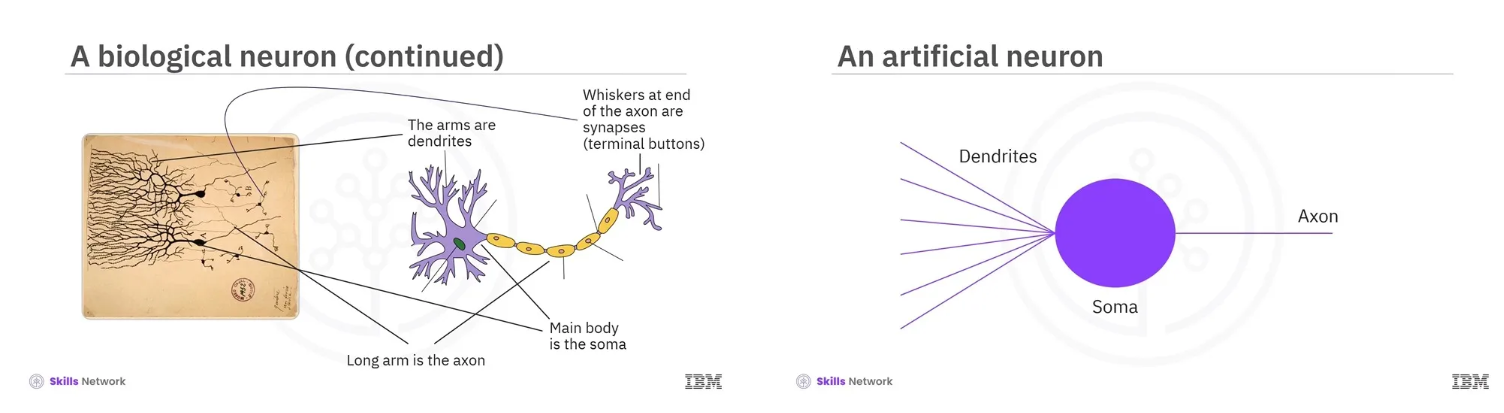

인공 뉴런은 구조적, 기능적으로 생물학적 뉴런과 유사하며, 학습은 반복을 통한 연결 강화로 이루어진다.

생물학적 뉴런(Biological Neuron)의 구성 요소

Soma (체세포): 뉴런의 중심이며 핵(nucleus)을 포함함.

Dendrites (수상돌기): 다른 뉴런의 시냅스(terminal buttons/synapses)에서 전기 신호를 받아 soma로 전달함.

Axon (축색돌기): soma에서 처리된 정보를 시냅스로 전달함.

Synapses (시냅스): axon의 끝부분, 다른 뉴런과 연결되는 지점.

뉴런 간 정보 흐름

Dendrites (수상돌기)에서 전기 신호(데이터)를 수신

→ soma와 nucleus에서 신호를 결합 및 처리

→ axon을 통해 신호를 출력

→ 시냅스를 통해 다음 뉴런에 전달

→ 연쇄적으로 수천 개의 뉴런으로 전달됨

학습 메커니즘 (실제 사람 뇌에서의 학습)

특정 연결을 반복적으로 활성화하면 해당 연결이 강화됨

원하는 결과가 발생하면, 그 결과를 만든 연결이 강화됨

이런 방식으로 뇌는 입력에 따라 더 잘 반응하도록 학습함

인공 뉴런(Artificial Neuron, Perceptron )

vs. 생물학적 뉴런(Biological Neuron)

구조: soma, dendrites, axon의 구조를 모방

기능: 입력 → 처리 → 출력 → 다음 뉴런으로 전달

학습 방식: 생물학적 뉴런과 유사하게 연결을 조정하여 원하는 출력이 나오도록 학습함

Artificial Neural Networks

다수의 이진 입력을 받아 이진 출력을 생성하는 방식으로 설계됨.

작동 원리

입력값들과 가중치의 곱을 합산 (weighted sum)

→ 여기에 편향(bias)을 더함

→ 이 값이 임계값(threshold)을 초과하면 출력은 1, 아니면 0

신경망의 구조

입력층 (Input Layer): 데이터를 처음 받는 계층

은닉층 (Hidden Layers): 입력과 출력 사이에 위치하며 내부 처리를 수행

출력층 (Output Layer): 예측 결과를 출력하는 계층

네트워크 구성: 여러 perceptron을 계층 형태로 연결

순전파 (Forward Propagation)

데이터 흐름: 입력층 → 은닉층 → 출력층

예를들어, 입력이 x1, x2, 가중치가 w1, w2, 편향이 b라고 하면,

입력의 선형 조합은 z = x1w1 + x2w2 + b가 된다.

하지만 신경망에서는 여기서 멈추지 않고, f(z)를 사용해 뉴런의 출력을 계산하는데,

여기서 f는 활성화 함수라고 부르며, 활성화 함수는 비선형 함수 형태이다.

결국 뉴런의 출력은

a = f(z)가 된다.

→ 왜 비선형이 필요한가?

z만 쓰면 직선밖에 표현 못한다. (선형 모델).

그런데 현실의 데이터는 곡선, 경계가 꼬인 문제가 훨씬 많다.

따라서 z를 선형 함수가 아닌 비선형 함수에 넣어서 a를 만들면, 훨씬 복잡하고 유연한 표현이 가능해지며, 이 것이 신경망이 복잡한 문제를 잘 푸는 비결이라 할 수 있다.

활성화 함수 (Activation Function)

비선형성을 부여해 복잡한 문제 해결 가능 (예: 이미지 분류, 언어 번역)

뉴런이 입력 정보에 반응할지 결정

활성화 함수가 없다면, 신경망은 단순한 선형 회귀 모델에 불과함

결론

신경망은 입력, 가중치, 편향을 이용하여 예측값을 계산함

네트워크의 복잡도와 상관없이 순전파는 동일한 방식으로 작동

주어진 신경망이 있으면 어떤 입력에 대해서도 출력값을 계산할 수 있어야 함

'🥇 certification logbook' 카테고리의 다른 글

| [Coursera/IBM course #2] CNN & RNN (1) | 2025.05.17 |

|---|---|

| [Coursera/IBM course #2] Deep Learning Libraries & Keras Models (1) | 2025.05.17 |

| [Coursera/IBM course #2] Backpropagation & Vanishing Gradient & Activation Functions (0) | 2025.05.11 |

| [Coursera/IBM course #2] Gradient Descent (0) | 2025.05.11 |

| [Coursera/IBM] Introduction to Deep Learning & Neural Networks with Keras 코스 소개 (1) | 2025.05.10 |

| [Coursera/IBM course #1] Evaluating and Validating Machine Learning Models (0) | 2025.05.10 |

| [Coursera/IBM course #1] Unsupervised Learning Models (0) | 2025.05.05 |

| [Coursera/IBM course #1] Supervised Learning Models (2) | 2025.05.04 |